Этика и безопасность в разработке ИИ-систем

Разбор фундаментальных принципов создания доверенного искусственного интеллекта от ведущих экспертов Lince Logic в Мадриде.

Почему данные и алгоритмы могут быть предвзятыми

В основе машинного обучения лежат исторические данные. Если эти данные содержат скрытые предубеждения, алгоритм неизбежно их наследует и масштабирует. В Lince Logic мы считаем, что борьба с предвзятостью начинается на этапе отбора обучающей выборки. Мы внедряем строгие протоколы аудита данных, чтобы исключить дискриминацию по любому признаку.

Приватность: Анонимизация данных клиентов

Защита конфиденциальности — наш главный приоритет. В наших проектах в Мадриде мы используем передовые методы десенсибилизации данных и дифференциальной приватности. Это позволяет обучать высокоточные модели без риска деанонимизации отдельных пользователей.

Прозрачность: Explainable AI (XAI)

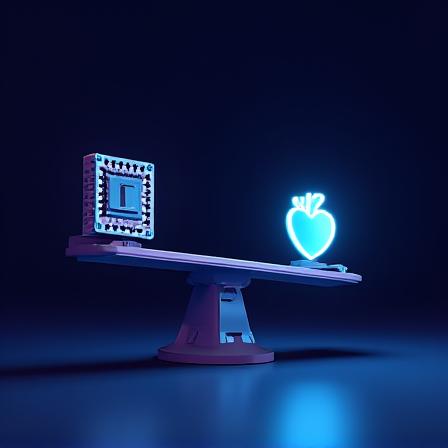

Принцип "черного ящика" больше не приемлем для критически важных бизнес-процессов. Мы внедряем методы объяснимого ИИ (XAI), которые позволяют понять, на основании каких факторов модель приняла то или иное решение. Это повышает уровень доверия и позволяет оперативно корректировать работу системы.

Наш подход в Мадриде

Lince Logic строго следует европейским регламентам GDPR и AI Act, обеспечивая юридическую чистоту и технологическую безопасность для всех наших корпоративных заказчиков в Испании и за её пределами.

Выводы для корпоративных заказчиков

Интеграция ИИ — это путь, требующий ответственности. Выбирая партнера, ориентируйтесь на прозрачность методологии и наличие этических стандартов разработки. Безопасный ИИ — это инвестиция в устойчивое будущее вашего бизнеса.